Dijital dünya, her geçen gün yeni bir yenilik sunarken, maalesef ki bu teknolojiler bazen kötü niyetli ellerde zarar verici araçlara dönüşebiliyor. Bugün, sizlere son dönemin en tehlikeli sahtekarlık yöntemlerinden biri olan “Yapay Zeka Dolandırıcılığı” üzerine kritik bilgiler vereceğim. Adım adım bu karanlık yöntemi çözümleyecek ve sizleri bu tür oyunlara karşı nasıl koruyabileceğinizi anlatacağım. Bu yazıyı okumadan önce belki Instagram ve Linkedin hesaplarımda paylaştığım videoyu izlemek isteyebilirsiniz.

Yapay Zeka Dolandırıcılığı Vakası: Fatih Portakal

İlk adımımız, ünlü haber spikeri Fatih Portakal’ın başına gelen bir olayı ele almak. Dolandırıcılar, Portakal’ın mevcut videolarından alınan basit bir ses örneği ile yapay zeka araçlarını kullanarak onun sesini klonladılar. Ardından, bu sesi kullanarak sanki Fatih Bey tarafından seslendirilmiş gibi metinler okuttular. Bu durum, nasıl bir ses klonlama teknolojisinin kullanıldığını ve bunun potansiyel tehlikelerini gözler önüne seriyor.

Yapay Zeka İle Ses Klonlamanın Teknik Detayları ve Kullanılan Yöntemler

Ses klonlama sürecinde genellikle “Deep Learning” adı verilen derin öğrenme modelleri kullanılır. Bu modeller, büyük veri setleri üzerinde eğitilir ve sesin tonlaması, vurgusu ve melodisini taklit edebilme yeteneğine sahip olur. Özellikle, “Text-to-Speech” (TTS) teknolojisi ve “Voice Conversion” teknikleri bu süreçte devreye girer:

- Text-to-Speech (Metinden Konuşmaya Çevirme): Bu teknoloji, yazılı metni insan sesine dönüştürmek için kullanılır. Google’nin WaveNet gibi sistemler bu alanda öne çıkar. WaveNet, ses dalgalarını birbirine bağlayarak doğal bir konuşma ritmi oluşturabilir.

- Voice Conversion (Ses Dönüşümü): Ses dönüşümü, bir kişinin sesini başka birinin sesine çevirme işlemidir. Bu, esasen modifiye edilmiş bir autoencoder kullanılarak gerçekleştirilir ve kişinin ses özelliklerini taklit etmek için özel algoritmalar içerir.

Gelişmiş Ses Klonlama Örnekleri ve Araçlar

Dünya genelinde ses klonlama için kullanılan bazı ileri düzey araçlar ve bunların uygulamaları:

- Lyrebird: Bu araç, sadece birkaç saniyelik ses kaydından yola çıkarak kişilerin seslerini klonlayabiliyor. Kullanıcılar kendi seslerinin dijital kopyalarını oluşturabilir ve bu sesleri çeşitli senaryolarda kullanabilirler.

- Adobe Voco: “Photoshop for voice” olarak da adlandırılan bu yazılım, ses düzenleme ve klonlama konusunda oldukça güçlüdür. Adobe Voco, kullanıcıların ses kayıtlarını düzenlemelerine ve kelimeleri seslendirilmiş gibi değiştirmelerine olanak tanır.

Potansiyel Tehlikeler ve Korunma Yolları

Yapay zeka ile ses klonlama teknolojisinin kötüye kullanılma potansiyeli, özellikle kişisel ve kurumsal güvenlik açısından ciddi riskler taşır. Örneğin, bir CEO’nun sesinin klonlanması ve ardından önemli finansal bilgilerin elde edilmesi gibi senaryolar mümkündür. Bu tür dolandırıcılıklardan korunmak için şüpheli telefon aramaları ve ses kayıtlarına karşı tetikte olunması, güvenliğin artırılması için çok katmanlı doğrulama sistemlerinin kullanılması önerilir.

Bu teknolojilerin farkında olmak ve nasıl çalıştıklarını anlamak, onlara karşı daha hazırlıklı olmamızı sağlar. Dolayısıyla, yapay zeka dolandırıcılıklarıyla mücadelede bilgi, en değerli savunmamızdır. Daha önce kaleme aldığım “Robot Sophia Bir Aldatmacadan İbaret Mi Yoksa Gerçekten Bizim Gibi Mi?” yazımda da bahsettiğim üzere ilerde bizim gibi davranan ama sanal olan veya robot olan klonlarımız oluşmaya başlayacak. Bu nedenle acilen farkındalığı ve yapay zeka okuryazarlığını artırmak, devlet nezdinde bunun için bilinçlendirme çalışmaları da yapmak gerekiyor.

Video Montajı ve Dijital Manipülasyon

İkinci olarak, yine dijital araçlarla gerçekleştirilen bir video montajına dikkat çekmek istiyorum. Bu teknikle, dolandırıcılar, Fatih Bey’in dudak hareketlerini kusursuzca bir videoya monte ettiler. Ortaya çıkan bu video, gerçeği aratmayacak kadar inandırıcıydı. Bu tür videolar, özellikle sosyal medya platformlarında hızla yayılabiliyor ve büyük bir izleyici kitlesine ulaşabiliyor. Peki, gerçek videolarla sahte videolar arasındaki farkları nasıl anlayabiliriz? İşte bu konuda bilinmesi gerekenler ve kullanılabilecek bazı yöntemler:

Teknik Detaylar: Video Montajında Kullanılan Yöntemler

Video montajı, genellikle “Deepfake” teknolojisi kullanılarak yapılır. Bu teknoloji, yapay zeka destekli algoritmalar sayesinde bir kişinin yüzünü, başka bir kişinin yüzüyle gerçek zamanlı olarak değiştirebilir. Bu işlem için öncelikle hedef kişinin yüzünün detaylı bir şekilde dijital bir haritası çıkarılır ve ardından bu yüz, diğer videolardaki kişinin yüzüyle birebir örtüşecek şekilde ayarlanır.

Gerçek Videoları Sahte Videolardan Ayırt Etme Yöntemleri Nelerdir?

- Dudak Senkronizasyonuna Dikkat Edin:

- Sahte videolarda, ses ve dudak hareketleri arasında tam bir uyum olmayabilir. Gerçek videolarda ise, konuşma ve dudak hareketleri arasında gözle görülür bir senkronizasyon vardır.

- Göz Hareketlerini İnceleyin:

- İnsanlar konuşurken doğal olarak göz kırpma ve çeşitli göz hareketleri yaparlar. Deepfake videolarında, göz hareketleri genellikle daha az doğal veya mekanik görünebilir.

- Yüzün Detaylarına Bakın:

- Sahte videolarda yüz hatlarında bazı anomaliler olabilir. Özellikle yüzün belirli bölümlerinde bulanıklık veya dalgalanma gibi düzensizlikler dikkat çeker.

- Arka Plan ve Işık Oyunları:

- Video montajında kullanılan yapay zeka modelleri, genellikle arka planı ve ışık oyunlarını doğru bir şekilde işleyemez. Arka planın bulanık olduğu veya ışığın yüzdeki etkisinin tutarsız olduğu videolar, sahte olabilir.

- Uzman Yazılımlar Kullanarak Analiz Yapın:

- Gelişmiş video analiz yazılımları, deepfake videolarını tespit etmek için kullanılabilir. Bu yazılımlar, video içerisindeki yüz ve ses verilerini detaylı bir şekilde inceleyerek, herhangi bir manipülasyon işareti olup olmadığını belirler.

Bu teknolojik gelişmeler her ne kadar heyecan verici olsa da, kötüye kullanımları da beraberinde riskler getirmektedir. Dolandırıcılık amaçlı kullanılan bu tür videolara karşı uyanık olmak ve yukarıda belirtilen ipuçlarını kullanarak gerçek içerikleri sahtelerinden ayırt etmek büyük önem taşımaktadır. Bu bilgiler, sizin ve sevdiklerinizin dijital güvenliği için kritik bir kalkan oluşturabilir.

Yapay Zeka Dolandırıcılığı İle Phishing ve Sahte Reklamlarla Kara Propaganda

En tehlikeli adım ise, oluşturulan bu sahte içeriklerin reklam olarak kullanılması. Dolandırıcılar, yatırım ve finans gibi spesifik ilgi alanlarına yönelik olarak tasarladıkları reklamları Instagram, Twitter ve Facebook gibi platformlarda yayınlıyorlar.

Phishing saldırıları, genelde masum görünümlü bir link içeren ve güvenilir bir kaynaktan geldiği izlenimi uyandıran e-postalar, sosyal medya mesajları ya da SMS’ler şeklinde kullanıcılara ulaşır. Bu mesajlar, kullanıcıları sahte bir web sitesine yönlendirir. Web sitesi, gerçek bir siteyle neredeyse aynı görünebilir ve kullanıcıdan kullanıcı adı, parola, kredi kartı numarası gibi kişisel bilgilerini girmesini ister. Detayları öğrenmek için “Phishing Nedir? Anlamı ve Nasıl Çalışır?” başlıklı yazıma göz atabilirsiniz.

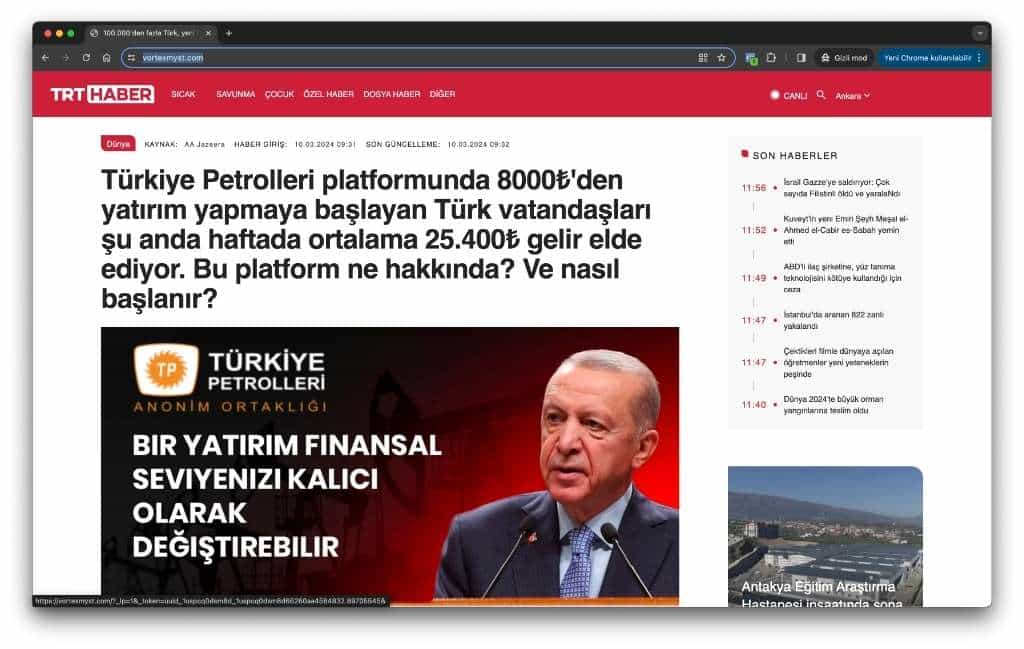

Bu örnekteki reklamlar SSL sertifikası olan ve TRT Haber logosu ile süslenmiş bir alan adı (websitesine) trafik çekmek için tasarlanmış. Böylece, kullanıcılar gerçek bir haber sitesini ziyaret ettiklerini düşünerek güveniyorlar.

Yasal Olmayan Sosyal Kanıtlar ve Ünlü İsimlerin Kötüye Kullanılması

Ayrıca, bu sahte haberlerde sosyal kanıt oluşturmak için Türkiye’nin önde gelen siyasi figürleri ve ünlü aktörler kullanılıyor. Dolandırıcılar, bu ünlü isimlerin fotoğraflarını ve isimlerini kullanarak insanları manipüle etmeye çalışıyorlar. Bu tür pratikler, yasal olmayıp, aynı zamanda etik dışı bir davranış biçimidir. Aşağıda, bu tür manipülatif tekniklerden bazılarını ve bu yöntemlere karşı bilinçlenmek için neler yapabileceğinizi anlatacağım.

FOMO ve Sosyal Kanıt: Manipülasyonun Psikolojik Araçları

- FOMO (Fear of Missing Out – Kaçırma Korkusu): FOMO, bireylerin bir şeyleri kaçırma korkusu üzerine kurulu bir psikolojik tetikleyicidir. Dolandırıcılar, genellikle insanlarda aciliyet hissi yaratmak için FOMO’yu kullanır. Örneğin, “Sınırlı süre için geçerli teklif!”, “Herkes bunu konuşuyor, kaçırmayın!” gibi ifadelerle bireyleri hızlı ve düşünmeden karar vermeye itebilirler. Bu tür ifadeler, özellikle yüksek kar vaadi sunan yatırım ve ürün reklamlarında sıklıkla görülür.

- Sosyal Kanıt (Social Proof):Sosyal kanıt, bir kişinin, çevresindekilerin davranışlarını doğru davranış modeli olarak kabul etme eğilimidir. İnsanlar, başkalarının yaptıklarını doğru kabul edip, onları taklit etme eğilimindedir. Dolandırıcılar, sahte ünlü endosmanları (onayları) veya yalan yanlış kullanıcı yorumları ile bu eğilimi manipüle eder. Örneğin, ünlü bir siyasetçinin veya sanatçının desteklediği iddia edilen sahte haberler, insanları bu haberlere inanmaya veya ilgili ürünlere para yatırmaya teşvik edebilir.

Bu Yöntemlere Karşı Koymak:

- Kaynakları Doğrulayın: Herhangi bir iddia veya ürünle ilgili olarak sunulan bilgilerin gerçekliğini kendi başınıza kontrol edin. Resmi web siteleri, güvenilir haber kaynakları ve eleştirmenlerden gelen bilgileri referans alın.

- Tepkisel Kararlardan Kaçının: FOMO tarafından tetiklenen acele kararlar genellikle pişmanlıkla sonuçlanır. Bir teklif veya ürün hakkında karar vermeden önce yeterince düşünmek, araştırmak ve sorgulamak önemlidir.

- Sosyal Kanıtların Güvenilirliğini Sorgulayın: Bir ürün veya hizmet hakkında yapılan yorumların ve önerilerin gerçek kullanıcılardan gelip gelmediğini analiz edin. Çoğu platform, kullanıcı yorumlarının doğruluğunu kontrol etme konusunda çeşitli yöntemler sunmaktadır.

FOMO ve sosyal kanıt gibi psikolojik araçlar, doğru kullanıldığında pazarlama stratejilerinde etkili olabilir. Ancak, dolandırıcıların elinde bu tür araçlar, masum bireyleri mağdur edebilir. Dolayısıyla, bu tür taktiklere karşı daima tetikte olmak, bilinçli kararlar almak ve çevremizdekilere de bu konularda bilgi vermek, dijital çağda sağlam durabilmemiz için şarttır.